A DARPA pretende que os oficiais militares tenham mais confiança nos sistemas de AI que estão integrados nas armas. Para esse efeito, a agência vai investir mais dois mil milhões de dólares em alguns projetos que já estão a ser desenvolvidos atualmente. O investimento é relativamente reduzido em comparação com outros, mas trata-se do maior esforço até hoje em sistemas de AI. O montante é semelhante ao que foi alocado pelos EUA no Projeto Manhattan em termos absolutos. Em valores atuais, devido à inflação, os EUA terão investido 28 mil milhões de dólares naquele projeto da II Guerra Mundial.

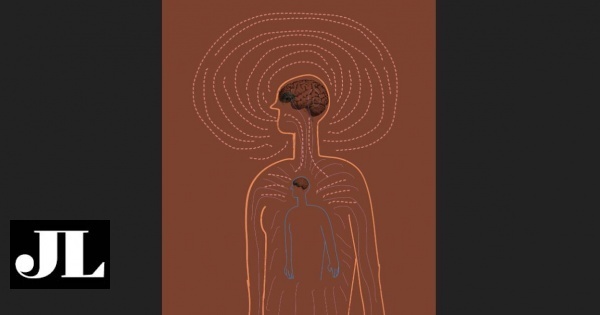

O objetivo das autoridades é permitir que os responsáveis militares tenham mais confiança nos sistemas de AI e que estes consigam explicar o processo pelo qual estão a tomar decisões, em cenários de guerra, com muitas variáveis. Atualmente, os sistemas já são capazes de identificar alvos, monitorizar e disparar de forma independente, com base em cálculos probabilísticos, representados muitas vezes sob a forma de percentagens de sucesso. Agora, as autoridades pretendem que os sistemas consigam explicar como chegaram a determinada conclusão e por que é que consideram ser aquele o alvo pretendido. Com esta argumentação em vigor, os decisores militares podem ter mais confiança na robustez do sistema e assegurar que todas as variáveis, muitas vezes imprevistas, estão a ser tomadas em consideração pelas máquinas, explica o The Verge.

O diretor da DARPA, Steven Walker, explica que «o que estamos a tentar fazer é que o sistema de AI diga aos humanos: “esta é a resposta e aqui está porque é que penso que esta é a resposta certa” e que consiga explicar como é que chegou a determinada conclusão».

Ainda não há detalhes sobre exatamente que projetos é que irão receber estes investimentos e exatamente como é que os sistemas vão ser preparados para fornecer estas explicações em cenários de guerra. A DARPA considera que conseguir oferecer estas respostas é crítico para o futuro dos sistemas AI junto dos militares.

O processo de tomada de decisão humano e a racionalidade dependem de muitos mais fatores do que apenas seguir regras, que é onde as máquinas são mesmo boas. São necessários anos para se construir um sentido moral e capacidades de pensar com senso comum, características que os especialistas estão a tentar colocar atualmente nas máquinas.

Michael Horowitz, que trabalhou nesta área para o Pentágono em 2013 e que atualmente dá aulas na Universidade da Pensilvânia, explica que há «muitos receios sobre a segurança da AI – [e sobre] algoritmos que não são capazes de se adaptar a realidades complexas e que, por isso, podem funcionar de formas inesperadas. Uma coisa é quando se fala sobre uma pesquisa no Google e outra coisa é se estamos a falar de sistemas de armamento». Se os sistemas conseguirem provar que estão a usar o senso comum, «é mais provável que os líderes seniores e os utilizadores finais os queiram usar», considera este especialista.

A DARPA tem atualmente 25 programas sobre o desenvolvimento de Inteligência Artificial a decorrer e tem prevista a atribuição de um milhão de dólares a todos os que consigam ensinar as máquinas a perceber contextos, tornando-as mais adequadas a operações em ambientes complexos.